반응형

Notice

Recent Posts

Recent Comments

Link

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

Tags

- CNN

- 백준

- 파이썬

- Computer Vision

- Regularization

- Unsupervised learning

- logistic regression

- 비용함수

- 신경망

- OpenGL

- 컴퓨터 그래픽스

- Support Vector Machine

- petal to metal

- 추천 시스템

- SVM

- neural network

- cs231n

- C++

- SGD

- Vision

- 머신러닝

- pre-trained

- 로지스틱 회귀

- 딥러닝

- CPP

- recommender system

- 그래픽스

- Kaggle

- 컴퓨터 비전

- 인공지능

Archives

- Today

- Total

kwan's note

Normal Equation-정규방정식 본문

반응형

출처: machine learning by andrew ng, stanford cousera lecture

수강일시: 2021.01.25

reminder-by-kwan.tistory.com/89

gradient descent(경사하강법)

출처: machine learning by andrew ng, stanford cousera lecture 수강일시: 2021.01.24 reminder-by-kwan.tistory.com/88 Cost function -비용함수/ 손실함수 출처: machine learning by andrew ng, stanford cou..

reminder-by-kwan.tistory.com

gradient descent 방법에 이어 normal equation을 통해 cost function의 최소를 구하는 방식에 대해 배워보도록 하겠습니다.

경사하강법은 cost function의 minumum을 수치적으로 분석한반면 normal equation은 대수적으로 접근해서 해를 구한다. normal equation의 key idea는 미분값이 0이 되도록하는 값을 찾는것이다.

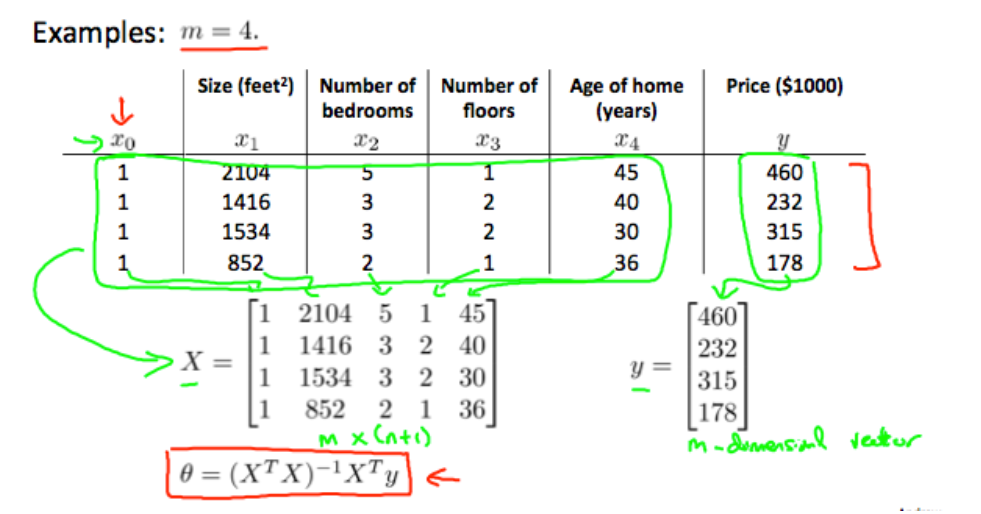

n개의 feature를 가진 m개의 data가 있는 경우를 살펴보자.

여기서는 m=4이다.

normal eqaution에선 scaling이 필요하지 않다.(대수적으로 계산하므로)

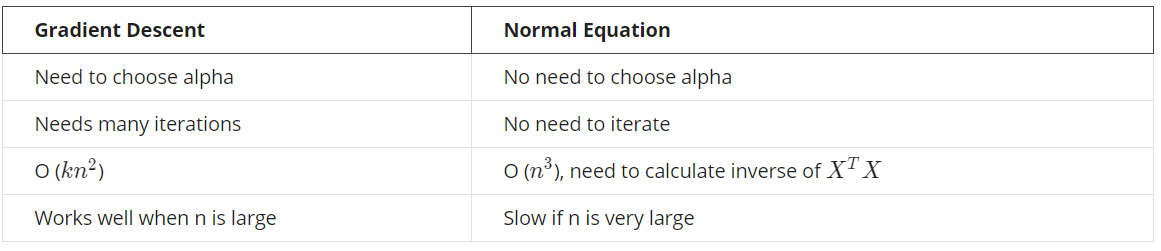

다음은 경사하강법과 정규방정식의 비교이다.

정규방정식은 feture가 커지면 사용하기 힘들다 빅오 노테이션으로 n세제곱이 되기 때문이다.

반응형

'ML and AI > Machine learning - Andrew Ng' 카테고리의 다른 글

| cost function in logistic regression -로지스틱 회귀에서 비용함수 (0) | 2021.01.26 |

|---|---|

| logistic regression -로지스틱 회귀 (0) | 2021.01.26 |

| gradient descent(경사하강법) (0) | 2021.01.24 |

| Cost function -비용함수/ 손실함수 (0) | 2021.01.24 |

| unsupervised learning -비지도학습 (0) | 2021.01.24 |