| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | 7 |

| 8 | 9 | 10 | 11 | 12 | 13 | 14 |

| 15 | 16 | 17 | 18 | 19 | 20 | 21 |

| 22 | 23 | 24 | 25 | 26 | 27 | 28 |

| 29 | 30 |

- CNN

- 인공지능

- 백준

- 컴퓨터 그래픽스

- SGD

- 머신러닝

- 추천 시스템

- Regularization

- OpenGL

- Vision

- SVM

- logistic regression

- cs231n

- 그래픽스

- C++

- neural network

- 신경망

- Unsupervised learning

- Support Vector Machine

- 파이썬

- Computer Vision

- 로지스틱 회귀

- 딥러닝

- CPP

- 비용함수

- Kaggle

- 컴퓨터 비전

- pre-trained

- recommender system

- petal to metal

- Today

- Total

kwan's note

SVM support vector machine - 서포트 벡터 머신 본문

SVM support vector machine - 서포트 벡터 머신

kwan's note 2021. 2. 4. 03:21출처: machine learning by andrew ng, stanford cousera lecture

수강일시: 2021.02.02

reminder-by-kwan.tistory.com/94

regularization - 정규화

출처: machine learning by andrew ng, stanford cousera lecture 수강일시: 2021.01.27 reminder-by-kwan.tistory.com/93 overfitting- 과적합 출처: machine learning by andrew ng, stanford cousera lecture..

reminder-by-kwan.tistory.com

SVM의 수학적 배경이나 이해과정 이전에 먼저 타당성에 대한 검토를 하도록 하겠습니다.

이는 수업의 흐름과 동일하게 작성한 것이므로 먼저 타당성 검증을 하고 large margin에 대한 내용 그리고 수학적 배경을 살펴보고 다음장에서 kernel과 관련된 내용을 다루도록 하겠습니다.

reminder-by-kwan.tistory.com/91

logistic regression -로지스틱 회귀

출처: machine learning by andrew ng, stanford cousera lecture 수강일시: 2021.01.26 reminder-by-kwan.tistory.com/86 supervised learning -지도학습 출처: machine learning by andrew ng, stanford cousera..

reminder-by-kwan.tistory.com

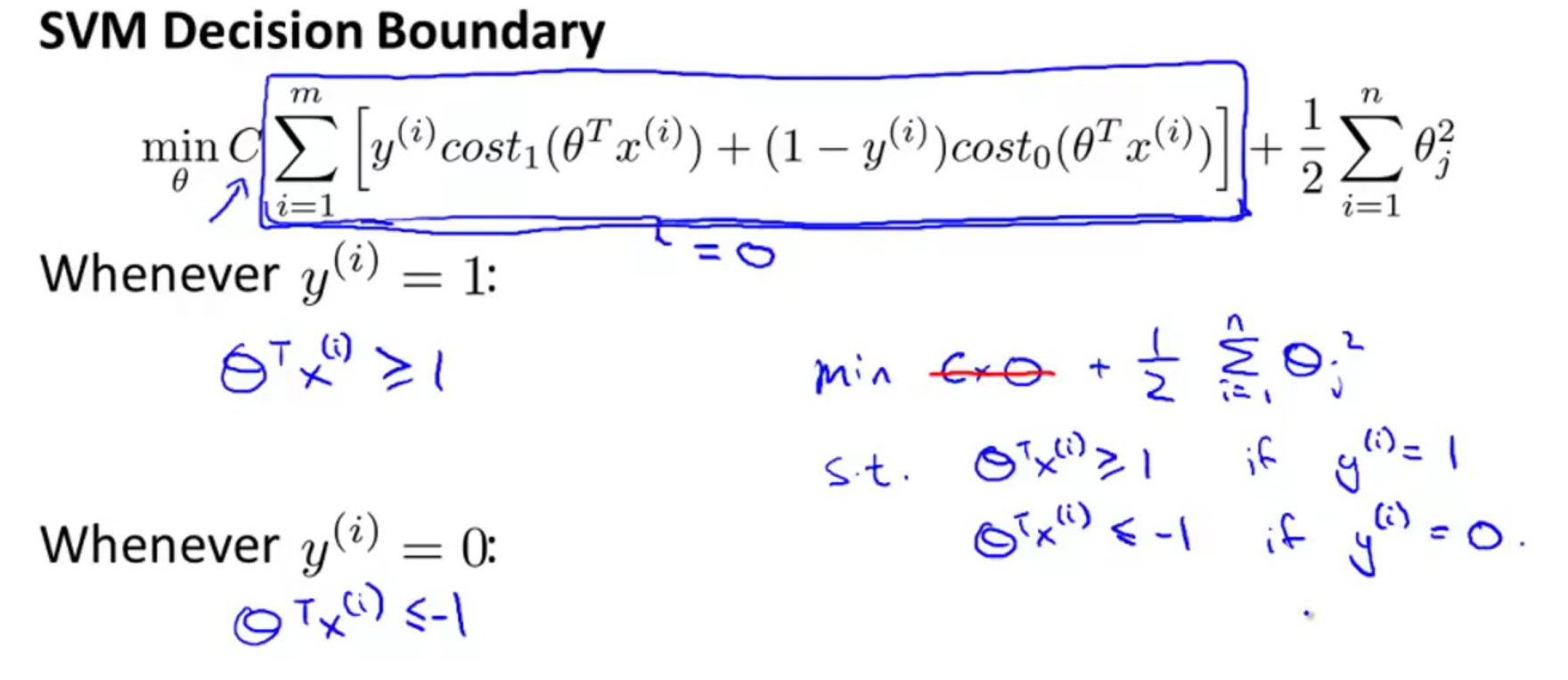

logistic regression에서 가설함수는 다음과 같았습니다.

이떄 cost function에대해서 생각해보면 아래와 같이 y=1, y=0일때로 나누고 이에대한 연산을 진행하였습니다.

그런데 이때 y=1에서 z가 1보다 큰 경우, y=0에서 z가 -1보다 작은경우에는 0으로, 이외에는 접선을 그어 연결하도록 하였습니다.

이렇게 하는 이유는 이를통해 연산량의 이점을 얻을 수 있기 때문입니다.

이를 통해 얻은 결과는 아래와 같습니다. 위 그래프를 cost라고 표현하였습니다.

이전에는 람다를 regression part에 붙였지만 cost part에 붙이는것으로 표현을 달리하였지만 의미가 변하지는 않습니다.

이제는 SVM의 의미에 대해서 생각해보도록 하겠습니다,

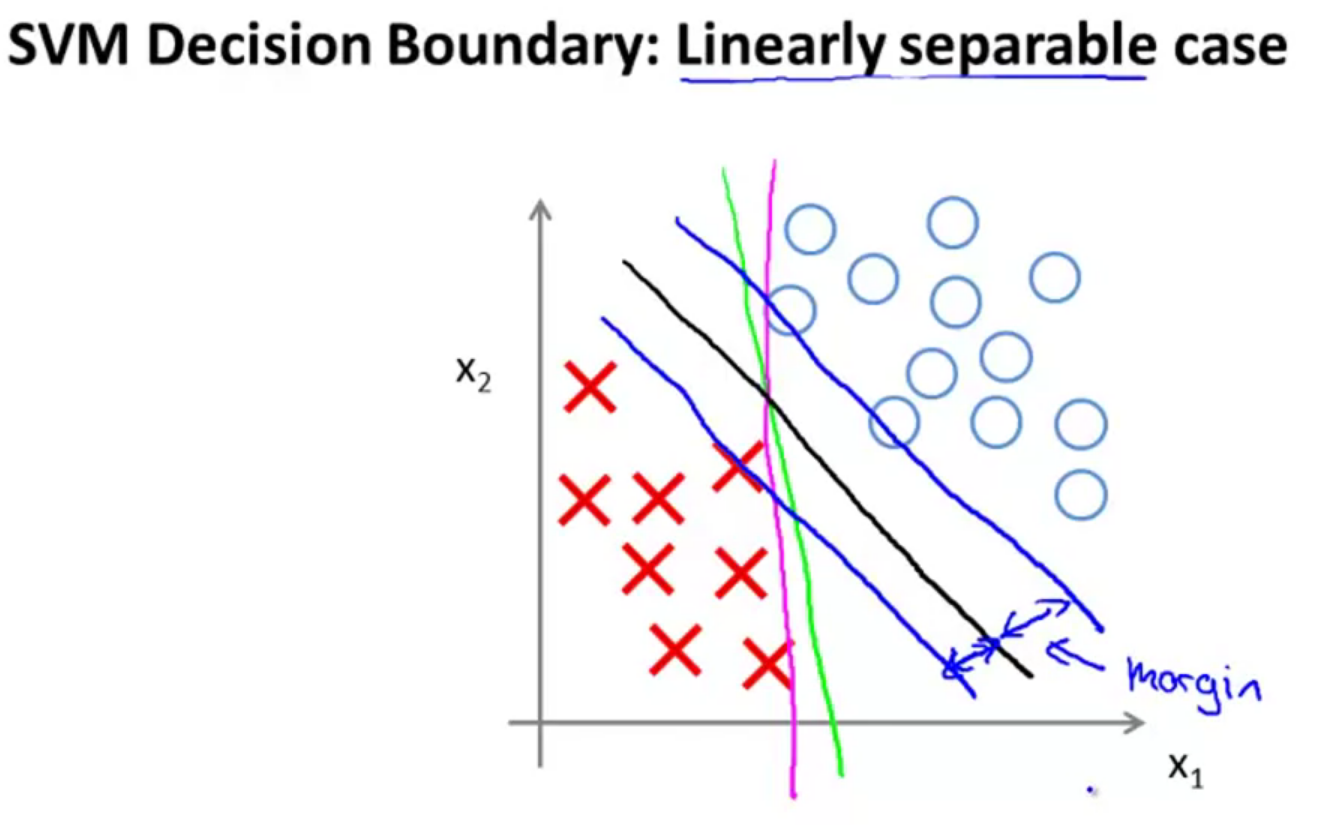

SVM은 때로 large margin classifier라고 하기도 합니다.

C가 매우 큰 경우 minimalize 하는 상황을 가정해봅시다.

C가 매우 크므로 costfunction이 0이 될때가 최솟값이 될 것입니다.

이는 위와같이 y=1이면 theta x 가 1보다 커야하고 y=0이면 theta x 가 -1보다 작아야 합니다.

SVM은 아래와 같이 초록, 보라색선이 아닌 검은색 선을 긋게됩니다.

즉, 거리(margin)가 최대가 되도록 하는 classification을 진행합니다.

C가 크다면 즉 regressioning이 적다면 검은색과 같은 선을 그리게 될 것입니다. 즉 이상치에 대해 적은 반응을 보일 것 입니다. 하지만 C가 매우 크다면 이상치에 대해서도 동일하게 반응하여 극단적인 large margin classification을 진행 할 것입니다.

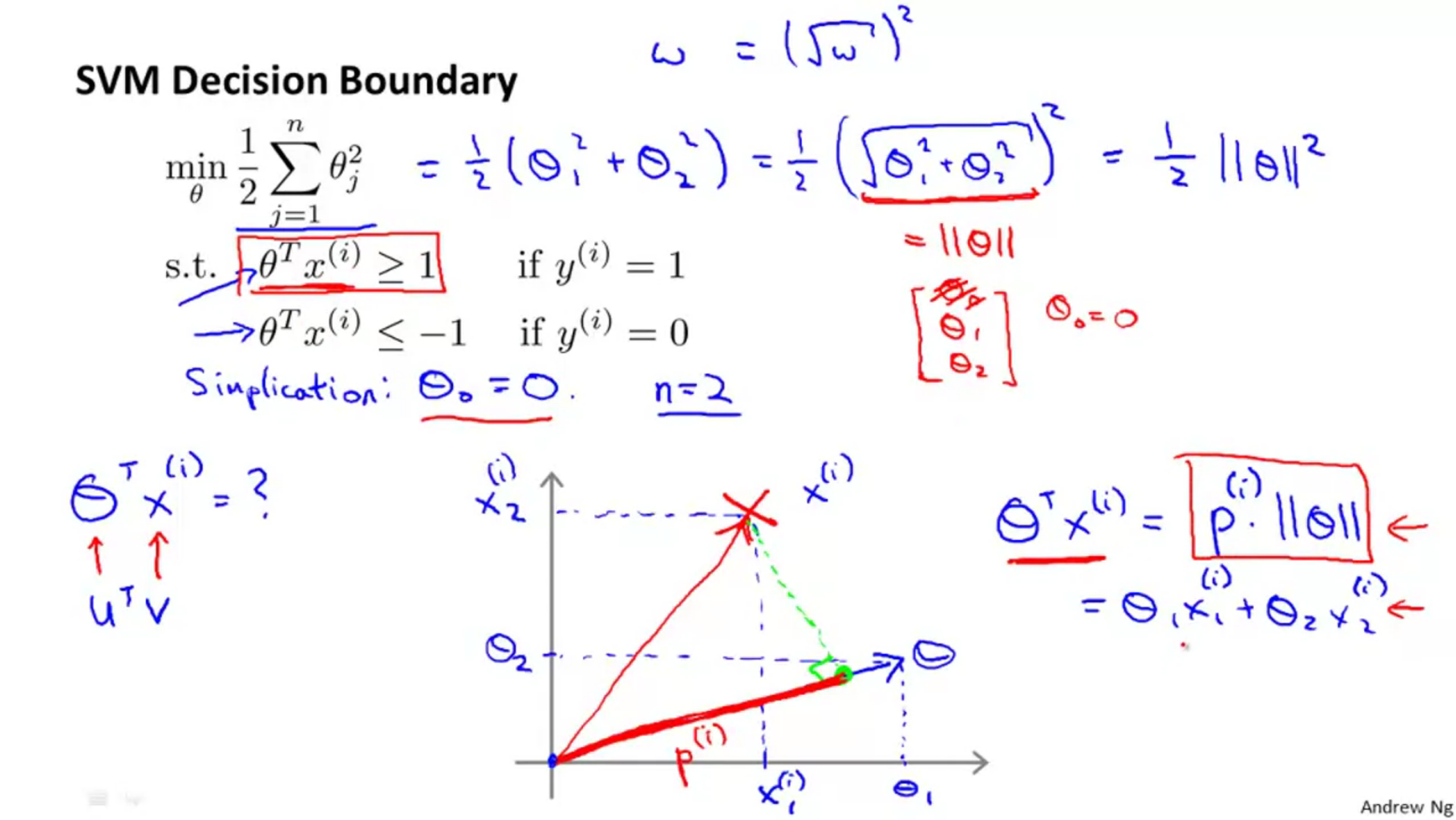

이제 위에서 적은식이 어떻게 large margin classifier가 되는지 생각해보겠습니다.

theta의 제곱의 최솟값을 구하는 문제에 있어서 theta 의 성분분해를 하여 theta1, theta2라고 한다면

이는 다시 norm의 제곱으로 볼 수 있다.

theta x 를 이용함에 있어서 x를 theta에 대해 사영시킨것을 p라고 한다면 p 에 norm(theta)의 곱으로 나타낼 수 있다.

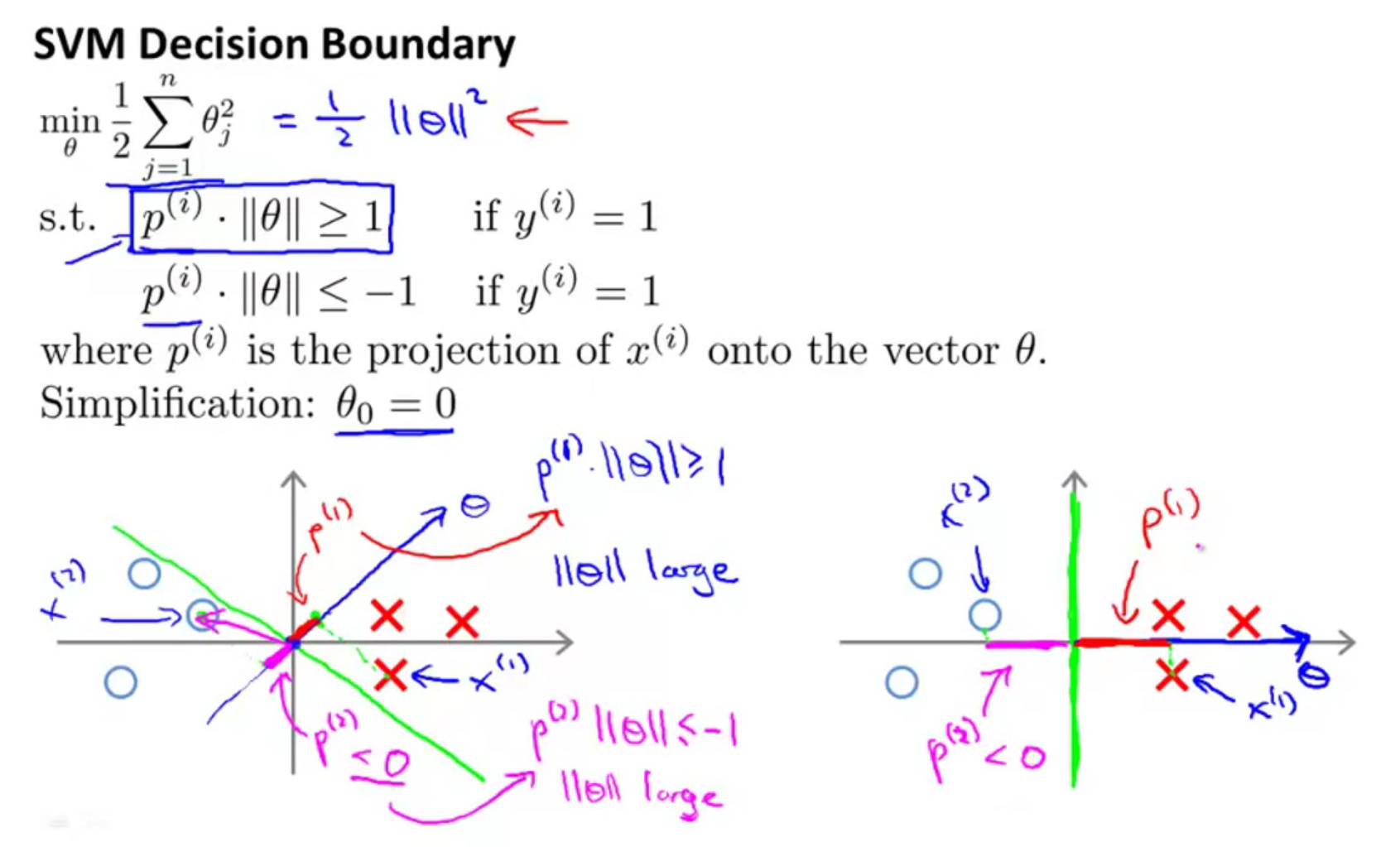

왼쪽 초록색 선과 같이 svm을 만들었다고 가정해보자. X에 대해서 theta에 사영을 시킨 p는 매우 작을 것이고 원하는값

즉, ptheta가 1보다 크거나 -1보다 작도록 하는 결과를 내려면 절대값이 작은 p에 대해 큰 theta를 필요로 할 것이다. 따라서 이는 min norm(theta)를 만족하지 않는다.

반면 오른쪽은 p를 크게하도록 하므로 theta의 norm값이 최소화 될 수 있다.

이에따라 large margin을 가지는 값이 svm이 된다.

다음시간에는 kernel에 관한 내용을 작성하겠습니다.

'ML and AI > Machine learning - Andrew Ng' 카테고리의 다른 글

| K means cluster (K 평균 군집) - 군집분석 (0) | 2021.02.05 |

|---|---|

| kernel in SVM- SVM에서 커널 (0) | 2021.02.04 |

| cross validation and fitting - 교차 검증과 피팅 (0) | 2021.01.31 |

| back propagation in neural network - 역전파 (0) | 2021.01.29 |

| neural network - 신경망 모델 이용 방법 (0) | 2021.01.28 |